Rapport Villani : en 2018, on parlait déjà de données de qualité

Le rapport Villani parlait déjà de données de qualité en 2018. Huit ans plus tard, le vrai sujet n’est plus le diagnostic, mais la vitesse d’exécution face aux usages IA.

En mars 2018, le rapport Villani sur l’intelligence artificielle formulait déjà un point fondamental, souvent oublié dans les débats actuels : une stratégie IA sérieuse suppose des données de qualité.

« Penser la politique de la donnée, ce n’est pas seulement penser les moyens d’accès ou de récupération des données existantes, c’est également penser à la mise en place de nouveaux moyens de collecte de données de qualité. »

— Rapport Villani, Partie 1, 2018, p. 58

Le sujet n’était donc ni caché, ni marginal, ni imprévisible. Le diagnostic public existait déjà. Ce qui frappe, huit ans plus tard, ce n’est pas la nouveauté du problème. C’est le retard accumulé dans son exécution.

Et ce retard devient beaucoup plus coûteux aujourd’hui qu’il ne l’était en 2018. Pourquoi ? Parce qu’on ne parle plus seulement de BI, de reporting ou d’analyses ponctuelles. On parle désormais d’IA générative, d’automatisation avancée, d’agents capables de recommander, déclencher ou orienter des actions à grande vitesse.

Dans ce nouveau contexte, la qualité des données ne peut plus être traitée comme une amélioration progressive. Elle redevient ce qu’elle a toujours dû être : une infrastructure stratégique.

Le diagnostic était déjà posé

Le mérite du rapport Villani, relu en 2026, est sa clarté. Il ne se contente pas de célébrer le potentiel de l’intelligence artificielle. Il rappelle très tôt qu’une politique de la donnée ne consiste pas seulement à ouvrir des accès ou accumuler des volumes, mais à organiser les conditions d’une donnée exploitable, robuste et de qualité.

Autrement dit : avant même la vague GenAI, avant l’explosion des assistants, avant l’agentique, le problème de fond était déjà là.

Nous savions déjà que :

- la qualité conditionne la valeur de la donnée ;

- la qualité conditionne la confiance ;

- la qualité conditionne la capacité à industrialiser des usages ;

- et la qualité conditionne, in fine, la performance des systèmes qui reposent sur cette donnée.

Le sujet n’était pas conceptuel. Il était structurel.

Ce qui a manqué : l’exécution

Si le diagnostic existait dès 2018, pourquoi le sujet paraît-il encore aussi actuel ? Parce qu’entre la prise de conscience et la transformation réelle, il y a souvent un fossé organisationnel.

Dans beaucoup d’environnements complexes — et particulièrement dans la santé — les mêmes obstacles ont persisté :

- systèmes hétérogènes,

- référentiels partiellement alignés,

- données incomplètes ou mal codées,

- faible lisibilité sur l’ownership,

- et investissements souvent orientés vers les usages visibles avant de consolider le socle.

On a parfois voulu accélérer sur les cas d’usage avant d’avoir sécurisé les fondations. Cela a produit un phénomène bien connu : des démonstrations convaincantes, mais des trajectoires d’industrialisation lentes, coûteuses et fragiles.

Le vrai sujet n’est donc pas de reprocher au passé de ne pas avoir tout résolu. Il est de reconnaître que nous avons trop longtemps sous-traité le problème de la qualité des données au second plan.

Pourquoi l’urgence est plus forte en 2026 qu’en 2018

En 2018, une mauvaise donnée pouvait déjà produire de mauvaises décisions. En 2026, elle peut surtout produire de mauvaises décisions automatisées, plus vite, sur plus de périmètres, avec une apparence de sophistication technologique.

C’est là que le contexte a changé.

Avec les architectures RAG, les assistants métiers, l’IA générative embarquée dans les workflows et les agents semi-autonomes, une donnée de mauvaise qualité ne reste plus confinée dans un fichier ou un reporting imparfait. Elle circule davantage. Elle alimente des systèmes qui génèrent du texte, des recommandations, des priorisations ou des actions.

Le coût de la non-qualité devient donc plus élevé sur trois plans :

- opérationnel — les usages produisent des erreurs ou des frictions ;

- économique — on dépense plus de temps, plus de compute et plus d’efforts humains pour compenser ;

- stratégique — on ralentit la capacité réelle à déployer des usages fiables à l’échelle.

Dans la santé, le message est encore plus clair

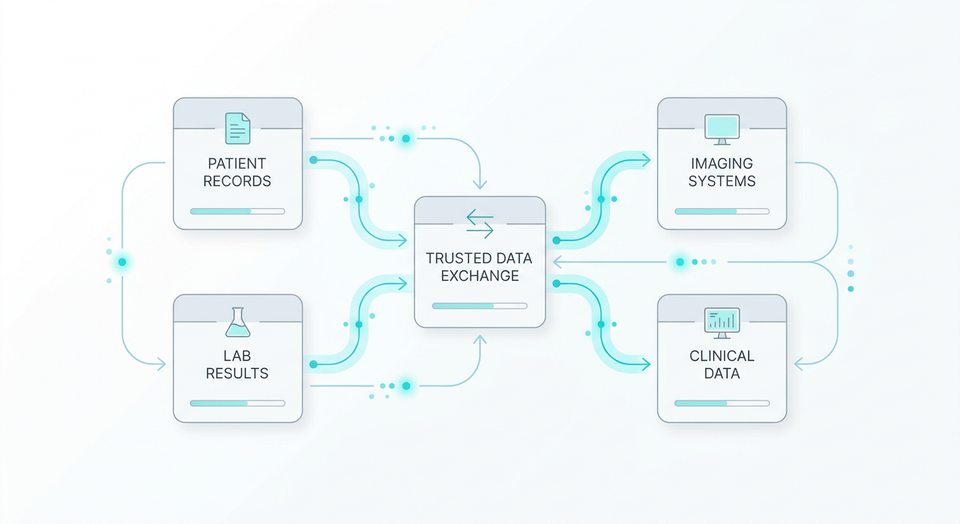

Le secteur de la santé concentre toutes les difficultés : multiplicité des applications, diversité des producteurs de données, enjeux réglementaires, contraintes de sécurité, hétérogénéité documentaire, historique applicatif lourd.

Dans ce contexte, la qualité des données n’est pas un luxe méthodologique. C’est une condition de faisabilité pour :

- l’interopérabilité,

- la réutilisation pour la recherche,

- la mesure de la qualité des parcours,

- l’exploitation d’outils IA,

- et demain, la conformité avec les cadres européens comme l’EHDS.

Autrement dit, le sujet que Villani pointait en 2018 est devenu encore plus concret : sans qualité de données, il n’y a ni IA fiable, ni partage robuste, ni mise à l’échelle sérieuse.

Le vrai décalage français : pas le diagnostic, la vitesse d’exécution

La tentation serait de lire cette histoire comme une énième preuve d’inertie. Ce serait un peu trop simple — et pas très utile.

Le point plus intéressant est ailleurs : la France a souvent une bonne capacité de diagnostic sur les sujets stratégiques liés à la donnée, à la régulation et à l’IA. En revanche, elle peine plus souvent sur la vitesse d’alignement opérationnel entre vision publique, gouvernance, budgets, systèmes et exécution terrain.

C’est précisément là que se joue maintenant l’avantage réel.

Les organisations qui gagneront ne seront pas celles qui parleront le mieux d’IA. Ce seront celles qui auront le plus rapidement transformé la qualité des données en capacité concrète :

- mesure,

- pilotage,

- correction,

- traçabilité,

- responsabilisation.

Ce que les directions devraient retenir aujourd’hui

Relire Villani en 2026 ne doit pas servir à dire “on savait déjà” par posture. Cela doit servir à poser une question plus utile : qu’avons-nous réellement mis en place depuis ?

Pour une direction générale, une DSI, une direction innovation ou une direction qualité, quatre questions deviennent structurantes :

- Quelles données critiques conditionnent nos usages IA présents et futurs ?

- Avons-nous une mesure objectivable de leur qualité ?

- Les responsabilités sont-elles claires entre production, gouvernance et usage ?

- Investissons-nous autant dans le socle data que dans les cas d’usage visibles ?

Si la réponse est non, alors le sujet prioritaire n’est pas d’ajouter une nouvelle couche d’intelligence. C’est de renforcer la qualité du terrain sur lequel cette intelligence repose.

En conclusion

Le rapport Villani n’avait pas “prédit” un détail technique. Il avait identifié une vérité durable : sans données de qualité, les ambitions IA restent bancales.

Huit ans plus tard, cette phrase n’a pas perdu en pertinence. Elle en a gagné.

Parce qu’aujourd’hui, nous ne branchons plus seulement des outils d’analyse sur nos données. Nous branchons des systèmes capables d’agir, d’orienter, d’automatiser et de se diffuser à grande échelle.

La qualité des données n’est donc pas un vieux sujet qu’on redécouvre. C’est le socle stratégique que nous n’avons plus le luxe de repousser.

La question n’est plus de savoir si le diagnostic était juste. Elle est de savoir si, cette fois, nous allons enfin exécuter à la hauteur de ce que nous savons déjà.

Sources

- Rapport Villani — Donner un sens à l’intelligence artificielle (2018), citation p. 58

- Ministère de l’Enseignement supérieur et de la Recherche — présentation du rapport de Cédric Villani

- WHO Europe — Health data governance in the age of artificial intelligence: policy imperatives for the WHO European Region

Vous voulez passer du diagnostic à l’exécution sur la qualité des données ?

Qalita aide les acteurs de santé à objectiver la qualité de leurs données, détecter les anomalies critiques et fiabiliser les usages IA avant la mise à l’échelle. Découvrir Qalita.