IA frugale : réduire les coûts commence par la qualité des données

Le vrai levier pour réduire la facture IA n’est pas toujours le choix du modèle. C’est souvent la qualité des données : moins de bruit, moins de tokens, moins de compute, plus de valeur.

Quand une organisation cherche à réduire ses coûts IA, elle regarde presque toujours au même endroit : le choix du modèle, la négociation fournisseur, l’optimisation des prompts, le caching, la réduction des appels.

C’est utile. Mais ce n’est souvent pas le vrai levier principal.

La manière la plus structurante de réduire le coût de l’IA, c’est d’améliorer la qualité des données qu’on lui donne à traiter.

Pourquoi ? Parce qu’une IA ne consomme pas seulement du “génie modèle”. Elle consomme du contexte, du nettoyage implicite, de la désambiguïsation, des corrections, des répétitions, des rapprochements et des arbitrages que de meilleures données auraient évités en amont.

Dans un contexte où le compute devient plus rare, plus cher et plus stratégique, la data quality devient un levier direct de frugalité, de souveraineté et d’efficacité économique.

On sous-estime le coût des données sales

Quand des données sont dupliquées, mal structurées, incomplètes ou incohérentes, il faut plus de ressources pour arriver à un résultat exploitable. Cela se traduit très concrètement par :

- plus de documents à ingérer et à indexer ;

- plus de bruit dans les recherches et les systèmes RAG ;

- plus de tokens consommés pour contextualiser ;

- plus de vérifications, reformulations et relances ;

- plus de latence ;

- et souvent, paradoxalement, moins de fiabilité.

Autrement dit, beaucoup d’organisations paient du compute pour compenser des défauts qui relèvent d’abord de la qualité de leurs données.

Le vrai sujet : ne pas faire porter au modèle le travail du socle data

Un modèle puissant peut corriger certaines ambiguïtés. Il peut rapprocher des formulations proches, interpréter un contexte flou, ou produire une réponse acceptable malgré un corpus imparfait.

Mais si on lui confie systématiquement ce travail de rattrapage, on lui demande en réalité de compenser :

- des référentiels mal alignés,

- des documents redondants,

- des champs vides,

- des versions contradictoires,

- des nomenclatures non harmonisées,

- ou un historique documentaire peu gouverné.

C’est une erreur d’architecture. Le modèle doit créer de la valeur, pas absorber indéfiniment la dette qualité amont.

Données propres = moins de compute pour plus de valeur

Quand les données sont mieux gouvernées et plus propres, on peut souvent :

- utiliser des corpus plus petits mais plus pertinents ;

- réduire le volume de contexte envoyé au modèle ;

- améliorer le rappel et la précision dans un moteur de recherche ou un RAG ;

- descendre sur des modèles plus compacts pour certains usages ;

- réduire les itérations correctives et les contrôles manuels.

Le gain n’est pas seulement budgétaire. Il est aussi opérationnel : réponses plus rapides, expérience plus stable, architecture plus simple, pilotage plus maîtrisable.

En d’autres termes, une bonne qualité de données permet de faire mieux avec moins.

Pourquoi ce sujet devient stratégique en Europe

Le débat sur le compute n’est pas purement technique. Il est aussi économique et géopolitique.

Les grands acteurs technologiques sécurisent des capacités massives de calcul, captent les infrastructures les plus performantes et structurent l’accès au GPU à l’échelle mondiale. Pour une entreprise européenne, et plus encore pour un acteur de la santé, l’hypothèse d’un compute abondant, illimité et bon marché n’est tout simplement pas réaliste.

Il faut donc raisonner autrement.

La frugalité n’est pas une version “low cost” de l’IA. C’est une discipline d’architecture. Elle consiste à réserver la puissance là où elle crée un avantage réel, et à supprimer tout ce qui consomme du calcul sans créer de valeur métier.

Or, parmi ces consommations inutiles, les données sales occupent une place énorme.

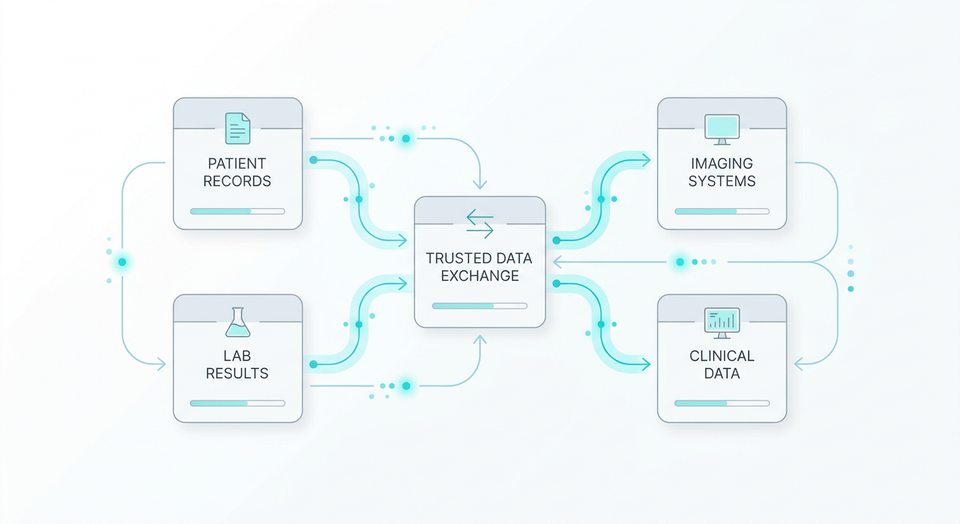

Dans la santé, la frugalité commence par l’harmonisation

Dans les organisations de santé, le problème est particulièrement visible : données réparties entre plusieurs applications, hétérogénéité documentaire, doublons, variations de codage, comptes rendus semi-structurés, référentiels imparfaitement alignés.

Si l’on branche de l’IA sur cet ensemble sans travail préalable, on obtient vite un système coûteux, fragile et difficile à industrialiser.

À l’inverse, quand on travaille en amont sur :

- la standardisation,

- la déduplication,

- la complétude des champs critiques,

- la cohérence entre sources,

- et la traçabilité,

on réduit la charge de calcul nécessaire pour produire un usage réellement robuste.

C’est particulièrement vrai pour les usages documentaires, l’aide à la recherche, les assistants métier et les architectures RAG, où la qualité du corpus pèse souvent plus que la sophistication brute du modèle.

Trois endroits où la data quality réduit immédiatement la facture IA

1. L’ingestion

Moins de doublons, moins de versions inutiles, moins de documents parasites : on indexe moins, on stocke mieux, on maintient un corpus plus léger.

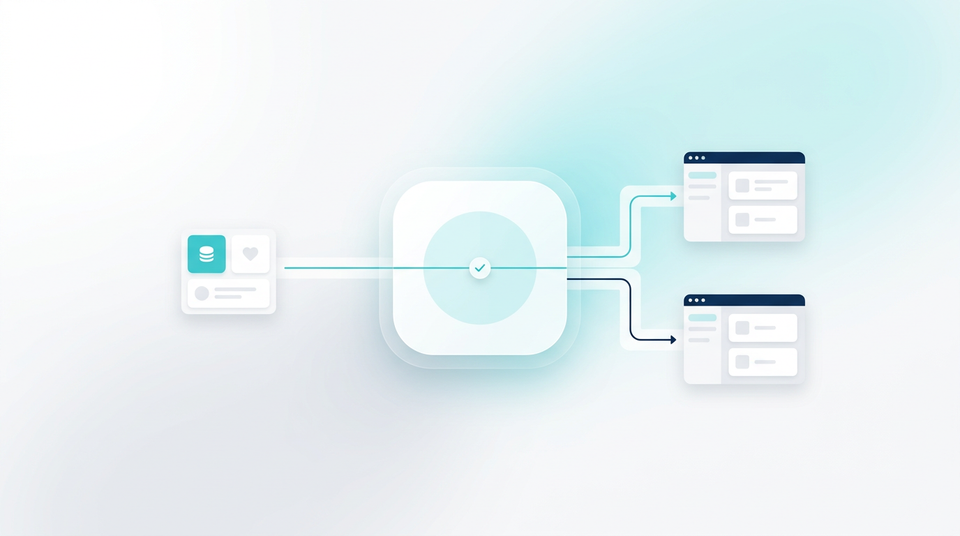

2. La recherche et le RAG

Un corpus mieux structuré permet de récupérer des éléments plus pertinents, avec moins de bruit. Résultat : moins de contexte à injecter, moins de tokens, moins de confusion.

3. L’exploitation en production

Quand la donnée est plus fiable, on corrige moins, on relance moins, on explique moins les erreurs du système aux utilisateurs. Le coût évité n’est pas seulement technique : il est aussi humain.

Le bon réflexe avant d’acheter plus de compute

Avant d’augmenter un budget IA, il vaut la peine de se poser quatre questions simples :

- Quelle part de notre coût vient vraiment du modèle, et quelle part vient de la mauvaise qualité des données ?

- Quelles sources génèrent le plus de bruit, de doublons ou de contexte inutile ?

- Quels usages pourraient fonctionner avec des modèles plus petits si le socle data était meilleur ?

- Avons-nous mesuré le coût de la non-qualité dans nos pipelines IA ?

Dans bien des cas, la réponse est contre-intuitive : le meilleur investissement n’est pas un modèle plus gros. C’est une donnée plus propre.

En conclusion

L’IA frugale n’est pas un discours défensif. C’est une stratégie de performance.

Dans un monde où le compute devient plus contraint, les organisations les plus intelligentes ne seront pas celles qui consomment le plus de puissance. Ce seront celles qui sauront réduire le besoin de puissance grâce à un meilleur niveau de qualité de données.

Avant d’acheter plus de compute, il faut mesurer le coût de ses mauvaises données.

C’est là que commence une IA plus rentable, plus souveraine et plus industrielle.

Sources

- IEA — Energy and AI: energy demand from AI

- ADEME — Nous avons besoin d’indicateurs fiables pour comparer les IA entre elles

- NIST — AI Risk Management Framework (AI RMF 1.0)

Vous cherchez à rendre vos usages IA plus sobres et plus fiables ?

Qalita aide les organisations de santé et les environnements réglementés à réduire le bruit documentaire, fiabiliser leurs données critiques et industrialiser des usages IA plus efficaces. Découvrir Qalita.